Wie heiß ist es wirklich?

Die Luft, die uns überall umgibt, ist unter anderem aufgrund ihrer Temperatur für unser Wohlbefinden verantwortlich. Ist es zu heiß oder zu kalt, fühlen wir uns nicht gut. Daher messen wir regelmäßig die Raumtemperatur, um durch Heizen oder mit Hilfe einer Klimaanlage das Raumklima zu regulieren. Beim Kochen und Backen oder auch beim Fiebermessen ist die Temperatur ebenfalls eine bekannte Größe, wie auch in vielen technischen Anwendungen oder im Labor. Um chemische Reaktionen definiert ablaufen zu lassen oder genaue und zuverlässige Analysenergebnisse zu produzieren, ist es notwendig, bestimmte Temperaturwerte zu überwachen und einzuhalten.

Wichtig – die Messgenauigkeit

Um die Eignung eines Thermometers für eine bestimmte Anwendung beurteilen zu können, muss die Messgenauigkeit beachtet werden. Sie ist eine wichtige Kennzahl für die Qualität einer Temperaturmessung, die sich auch im Vertrauen in die angezeigten Temperaturwerte widerspiegelt.

Was ist Messunsicherheit?

Die Fähigkeit eines Thermometers, Messwerte in der Nähe eines wahren Temperaturwerts zu liefern, wird als Genauigkeit bezeichnet. Sie ist der positive Ausdruck für die bei jedem Messgerät vorhandene Messunsicherheit.

Die Genauigkeit wird daher von Geräteherstellern dazu verwendet, die Qualität ihrer Sensoren zu beschreiben.

Die Messunsicherheit selbst beruht auf zum Teil gerätebedingten systematischen Messfehlern, die sich in positiven oder negativen Abweichungen auf den Messwert auswirken. Die Größe dieser Messfehler lassen sich theoretisch ableiten oder experimentell durch die Kalibrierung eines Thermometers bestimmen. Aufgrund der ermittelten Größe der Abweichungen, die als Korrekturwert in einem Messgerät oder in einem zugehörigen Kalibrierschein angegeben werden können, lassen sich diese Messfehler rechnerisch berichtigen.

Die Präzision hingegen beschreibt eine mittlere und zufällige Ergebnisunsicherheit. Diese beruht auf der statistischen Streuung der Messwerte und wird durch das Messunsicherheitsintervall beschrieben. Die Größe dieses Intervalls kann aus Wiederholungsmessungen mit gleichartigen Thermometern und vergleichbaren Messbedingungen mit Hilfe der Standardabweichung u errechnet werden.

Als Unsicherheitsintervall U wird häufig die doppelte Standardabweichung der erhaltenen Messwerte angegeben. Statistisch gesehen liegen 95,4% aller Temperaturwerte, die unter spezifizierten Bedingungen korrekt ermittelt wurden, in diesem Bereich. Das Unsicherheitsintervall wird immer als Differenz zu einem mittleren Messwert x0 angegeben, zum Beispiel +22 ±3 °C. Der wahre Temperaturwert liegt in diesem Fall mit hoher Wahrscheinlichkeit zwischen +19 und +25 °C.

Die Anforderungen an die Bestimmung und Bewertung der Messunsicherheit für Messprozesse im Labor sind in der international anerkannten technischen Regel ISO/IEC Guide 98-3:2008-09: Messunsicherheit – Teil 3: Leitfaden zur Angabe der Unsicherheit beim Messen beschrieben.

Einflüsse auf die Messunsicherheit

Die Messunsicherheit hängt zunächst vom ausgewählten Messverfahren und somit von dem verwendeten Thermometer selbst ab. Zum Fiebermessen kann entweder ein Glasthermometer, das die Temperatur durch die Ausdehnung von Alkohol in einer Kapillare misst, ein digitales Widerstands- oder ein Infrarotthermometer eingesetzt werden. Jedes dieser Thermometer hat aufgrund seines Aufbaus einen typischen Messfehler und liefert unterschiedlich genaue Messwerte.

Bei technischen Anwendungen mit Temperaturen bis ca. +300 °C liefern Widerstandsthermometer in der Regel deutlich bessere Messergebnisse als Thermoelemente.

Zudem kommt es auf den richtigen Einsatz eines Messverfahren sowie die korrekte Handhabung und Ablesung des Messgeräts an. Insbesondere bei dem klassischen Glasthermometer oder bei analogen Zeigergeräten kann es leicht zu Ablesefehlern kommen.

Kontaktthermometer, wie das Glas- und das Widerstandsthermometer, benötigen für genaue Messungen eine ausreichend große Kontaktfläche mit guter Wärmeübertragung zwischen Körper und Thermometer. Diese und eine Reihe weiterer Fehlerquellen führen zu Messabweichungen, sodass der gemessene Temperaturwert von der wahren Temperatur teilweise erheblich abweichen kann.

Die elektrische Temperaturmessung im Labor

Im Labor werden für genaue Messungen häufig Widerstandsthermometer eingesetzt. Diese sind Teil einer Messkette aus dem Temperatursensor, einem angeschlossen Messumformer, einer Auswerteelektronik oder einem Anzeigegerät einschließlich der notwendigen Anschlüssen und Zuleitungen. Diese haben alle, auch die Anschlüsse und Zuleitungen, einen Einfluss auf die Messgenauigkeit. So hat jedes Thermometer eine systematische Messabweichung zu einem idealen Thermometer oder einer normierten Thermometerkennlinie.

Für Widerstandsthermometer sind diese Kennlinien in der Norm EN 60751 beschreiben und Toleranzklassen mit maximal zulässigen Messabweichungen definiert. Thermometer des Typs Pt 100 mit der besten Toleranzklasse A dürfen zum Beispiel bei +22 °C nur einen Messfehler von weniger als 0,2 K aufweisen.

Die Signalübertragung und die Signalverarbeitung im angeschlossenen Messgerät haben eine bestimmte Unsicherheit und die Messwertanzeige ist auch nicht vollkommen linear. Zudem unterliegen alle Temperatursensoren einer Alterung, die zu einem allmählichen Drift der Messempfindlichkeit führt, sodass es bei der Messung aufgrund ungeeigneter Mess- oder nicht ausreichend stabiler Umgebungsbedingungen zu Signalabweichungen kommen kann.

So führt schon eine nicht ausreichende Eintauchtiefe eines Temperatursensors in das zu messsende Medium zu Wärmeableitfehlern, wie auch eine zu kurze Messdauer einen sogenannten Austemperierungsfehler zur Folge hat und in der Regel zu niedrige Messwerte liefert. Letzterer ist hauptsächlich durch die Trägheit der Temperaturmessung und die Wärmekapazität des Thermometers bedingt.

Besondere Fehlerquellen bei der elektrischen Temperaturmessung

Widerstandsthermometer benötigen einen Messstrom, der das Thermometer erwärmt. Hierdurch wird jedoch ein etwas zu hoher Messwert angezeigt. Dieser Fehler lässt sich durch einen möglichst kleinen Messstrom und kurze Messzeiten verringern. Außerdem führen der Leitungswiderstand sowie der Eingangswiderstand des eingesetzten Messgeräts zu Messfehlern, die sich durch eine geeignete Beschaltung und die richtige Geräteauswahl mit hohen Eingangswiderständen minimieren lassen.

Die Temperaturmessung mit Thermoelementen beruht auf dem Vergleich einer gemessenen Thermospannung mit einer Vergleichstemperatur, die zum Beispiel bei 0 °C liegen kann. Die Stabilität und Richtigkeit der Vergleichstemperatur hat einen großen Einfluss auf die korrekte Temperaturmessung.

Zudem haben die für den Anschluss an ein Messgerät verwenden Thermo- oder Ausgleichsleitungen, wie das Thermoelement selbst, typische temperaturabhängige Messabweichungen.

Auch durch unterschiedliche Materialien an Anschlussstellen zwischen Sensor, Vergleichsstelle und Messgerät können zusätzliche Thermospannungen auftreten, die zu Messfehlern führen.

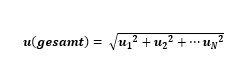

Auf Basis aller Fehlerquellen lässt sich der Gesamtfehler einer Temperaturmessung aus der Summe der Einzelfehler (u1, u2, … un) in einer bestimmten Messkette berechnen.

Mathematisch stellt sich die Unsicherheit einer Messkette u(gesamt) dann so dar:

Um Messfehler bei der Temperaturmessung bestimmen zu können, müssen Temperatursensoren regelmäßig überprüft werden. Bei dieser Kalibrierung werden insbesondere systematische Messabweichungen durch den Vergleich mit einem Thermometer bekannter Genauigkeit ermittelt. Hierdurch ist es möglich, die Ungenauigkeit der Messwertanzeige zu korrigieren oder ein Messgerät zu justieren.

Unabdingbar – die Prüfmittelüberwachung

Bei technischen Anwendungen und im Labor werden Temperatursensoren häufig als technische Prüfmittel eingesetzt, die unter anderem für eine spezifische Anwendung erforderliche Messgenauigkeiten einhalten müssen. Um diese Anforderung zu überwachen ist es notwendig, diese Thermometer im Rahmen einer regelmäßigen Prüfmittelüberwachung zu kalibrieren. Hierzu werden meist Referenzthermometer oder Referenznormale eingesetzt, die eine Rückführbarkeit der Temperaturmessungen auf nationale oder internationale Bezugsnormale ermöglichen.

Um dieses sicherzustellen, müssen eingesetzte Referenzthermometer durch anerkannte, DAkkS-akkreditiere Kalibrierlabore zertifiziert sein. Die Zertifizierung muss hierfür regelmäßig überprüft und erneuert werden.

Für jede Temperatur das richtige Messverfahren

Während für die Feststellung der Raumtemperatur gewöhnlich ein alkoholgefülltes Thermometer mit einem Messbereich von -10 °C bis +40 °C genügt, für die Lagerung von Tiefkühlkost Temperaturen unterhalb von -18 °C vorgeschrieben sind und mit dem Fieberthermometer nur der Bereich zwischen +36 °C bis +42 °C gemessen wird, sind die Anforderungen für Temperaturmessungen sowohl im wissenschaftlichen als auch im technischen Bereich sehr viel weiter gespannt.

In Schmelzöfen der Glasindustrie sind beispielsweise Temperaturen um +1000 °C zu messen, bei metallurgischen Prozessen können sie noch weit höher liegen. Medizinische Proben hingegen, wie Zell- und Genmaterial, werden in Biobanken bei -155 °C verwahrt und im physikalischen Labor, das sich mit supraleitenden Werkstoffen befasst, sind Temperaturen meist erst unter -250 °C interessant. Technisch bedingt ist jedoch jede Temperaturmessung fehlerbehaftet.

Mit mehr oder minder großem Aufwand können derartige, systematische Fehler erfasst und minimiert werden. Dabei sind nicht nur der Zweck einer Messung und der sich daraus ergebende Messbereich, sondern auch die notwendige Messgenauigkeit für die Wahl des Messverfahrens ausschlaggebend.

Reichelt Chemietechnik Magazin

Reichelt Chemietechnik Magazin